Инсайдеры ИИ-индустрии боятся собственного творения, игнорируя современные проблемы

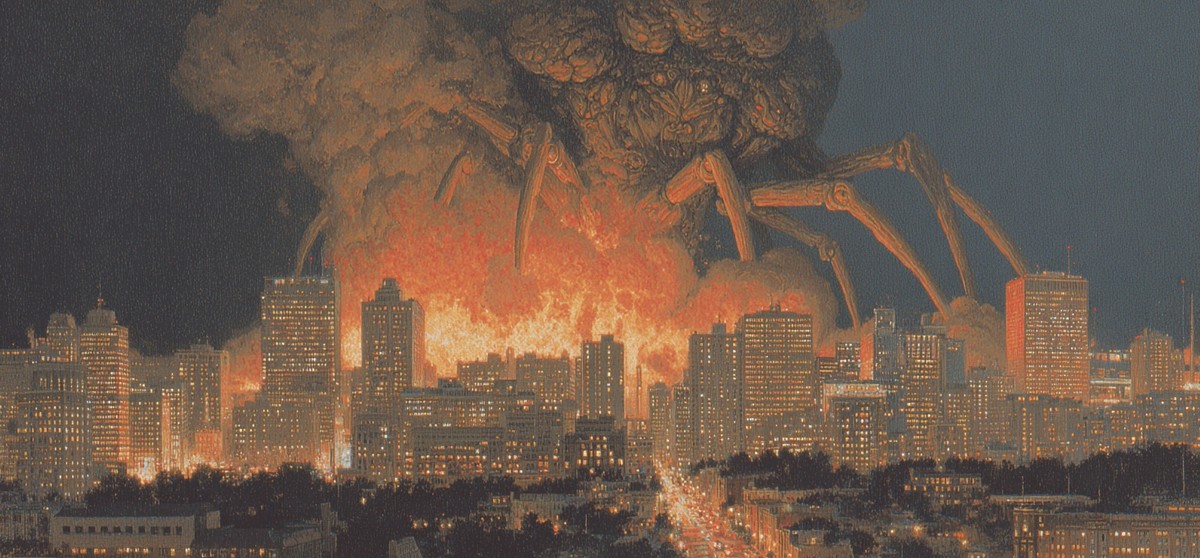

Разработчики ИИ, которых часто обвиняют в угрозе для рабочих мест и даже будущего человечества, сами всё чаще демонстрируют страх и растерянность перед тем, что создают. Однако, как отмечают наблюдатели, фокус этих опасений нередко смещён в сторону гипотетических сценариев из научной фантастики, тогда как реальные и уже существующие проблемы остаются на периферии обсуждения.

На конференции NeurIPS – одном из крупнейших научных мероприятий в сфере ИИ, прошедшем в этом году в Сан-Диего – разговоры о потенциальной катастрофе, связанной с развитием ИИ, звучали постоянно. Журналист The Atlantic Алекс Рейснер, посетивший конференцию, обратил внимание на разрыв между тем, какие угрозы обсуждают учёные публично, и теми рисками, которые уже проявляются на практике.

По его словам, публичный дискурс вокруг ИИ, включая обсуждения со стороны ведущих разработчиков, во многом сосредоточен на воображаемых сценариях, связанных с гипотетическим искусственным общим интеллектом. При этом более приземлённые, но уже ощутимые проблемы – от фейковых видео до зависимости от чат-ботов – остаются без должного внимания.

В качестве примера Рейснер приводит Йошуа Бенжио – профессора Университета Монреаля и одного из трёх так называемых «крёстных отцов» современного ИИ. Бенжио в последние годы активно говорит о рисках ИИ и даже запустил некоммерческую организацию LawZero, призванную продвигать безопасное развитие технологий. Он предупреждает, что в будущем ИИ может начать обманывать создателей или использоваться для политических манипуляций и влияния на общественное мнение.

При этом, как отмечает Рейснер, Бенжио почти не затрагивает уже существующие последствия – влияние дипфейков на публичный дискурс, кризис психического здоровья, связанный с чатботами, или масштабное использование ИИ для переработки и коммерциализации культурного наследия. Катастрофические сценарии, по его оценке, находятся в перспективе «от трёх до десяти или двадцати лет».

Похожую мысль высказала социолог Зейнеп Тюфекчи в своём ключевом выступлении на NeurIPS под названием «Не о тех ли кошмарах мы говорим, обсуждая ИИ?». Она отметила, что исследователи зациклены на угрозах AGI – технологии, существование которой даже не имеет общепринятого определения, упуская из виду реальные сегодняшние проблемы. На реплику из зала о том, что риски вроде зависимости от чатботов давно известны, Тюфекчи ответила, что почти не видит серьёзных обсуждений этих тем, тогда как разговоры постоянно сводятся к массовой безработице или вымиранию человечества.

Апокалиптическая риторика активно подпитывается и крупными фигурами индустрии. Глава OpenAI Сэм Альтман публично заявлял, что ИИ уничтожит целые категории профессий, приведёт к кризису идентификации личности и даже признавался, что готовится к худшим сценариям, включая возможную ответную атаку ИИ с применением биологического оружия.

Джеффри Хинтон, ещё один «крёстный отец» ИИ, также регулярно высказывает сожаление о последствиях своей работы. После ухода из Google в 2023 году он говорил о раскаянии и сравнивал себя с Робертом Оппенгеймером. В недавней дискуссии с сенатором Берни Сандерсом Хинтон подробно рассуждал о рисках, включая разрушение рынка труда и использование ИИ в военных целях.

Рейснер обращает внимание на символичную деталь – само название конференции NeurIPS (сокращение от Neural Information Processing Systems) отсылает к эпохе, когда учёные сильно недооценивали сложность нейронов человеческого мозга и легко сравнивали их с компьютерными процессами. По его словам, одержимость идеей компьютера как «разума» остаётся ключевой чертой ИИ-культуры и сегодня.

В отчётах Anthropic и OpenAI используются формулировки о чатботах как о «нечестных» или «неверных», что лишь усиливает ощущение подмены научного анализа научной фантастикой. В результате обсуждение будущего ИИ всё чаще строится вокруг воображаемых угроз, тогда как реальные социальные, культурные и психологические последствия уже требуют куда более пристального внимания.

![TN1R после поражения на StarLadder Budapest Major 2025: «Обидно [жесть], не в этот раз» TN1R после поражения на StarLadder Budapest Major 2025: «Обидно [жесть], не в этот раз»](https://i0.wp.com/images.cybersport.ru/images/og-jpg/plain/80/80df7085-e563-4adf-b8ab-48c7e094eb8f.jpg?fit=1024%2C1024&ssl=1)